📚 2026-02-20 AI 논문 핵심 요약

📊 순위 기반: 5개 | 🤖 GLM 추천: 5개 📄 전문 분석: 10개 | 📝 초록 분석: 0개

📑 목차

- 📊📄 SpargeAttention2: Trainable Sparse Attention … ⬆️24

- 📊📕 Unified Latents (UL): How to train your laten… ⬆️21 ❌

- 📊📄 Mobile-Agent-v3.5: Multi-platform Fundamental… ⬆️19

- 📊📕 “What Are You Doing?”: Effects of Intermediat… ⬆️12

- 📊📄 Calibrate-Then-Act: Cost-Aware Exploration in… ⬆️11

- 🤖📄 Arcee Trinity Large Technical Report ⬆️10

- 🤖📄 TactAlign: Human-to-Robot Policy Transfer via… ⬆️10

- 🤖📄 DDiT: Dynamic Patch Scheduling for Efficient … ⬆️9

- 🤖📄 Frontier AI Risk Management Framework in Prac… ⬆️7

- 🤖📄 ArXiv-to-Model: A Practical Study of Scientif… ⬆️4

1. SpargeAttention2: Trainable Sparse Attention via Hybrid Top-k+Top-p Masking and Distillation Fine-Tuning

arXiv: 2602.13515 | 기관: Tsinghua University | ⬆️ 24 📊 순위선정 | 📄 HTML 태그:

sparge-attention2sparse-attentionvideo-diffusionefficiencydistillationfine-tuningtransformer사전 지식: Transformer, Attention Mechanism, Diffusion Model, Sparse Attention, Knowledge Distillation

한 줄 요약

비디오 확산 모델(Video Diffusion Model)에서 학습 가능한 희소 주의(Sparse Attention) 기법을 통해 계산량을 95% 이상 줄이면서도 원본의 품질을 유지하여, 실용적인 고속 비디오 생성을 가능하게 했다는 점에서 중요합니다.

💡 핵심 아이디어

비디오를 생성할 때 모든 정보를 다 보는 대신, 중요한 부분만 골라보는 ‘시선’을 학습시키는 방식입니다. 마치 긴 문서를 요약할 때 단순히 ‘중요한 단어 K개’만 보거나 ‘문맥 파악이 될 만큼’만 보는 것 중 하나만 고집하는 게 아니라, 상황에 따라 이 둘을 적절히 섞어서 보는 전략을 학습합니다. 또한, 선생님처럼 모든 것을 다 보는 모델로부터 정답을 전수받는 증류(Distillation) 기법을 통해 정보를 건드리지 않으면서도 처리 속도를 비약적으로 높입니다.

문제 정의

비디오 생성 모델은 처리해야 할 데이터의 시퀀스 길이가 길어서 연산 복잡도가 $N$의 제곱($O(N^2)$)으로 비례하여 느립니다. 기존의 희소 주의 방식은 계산을 줄여주지만, 너무 많은 정보를 버리면 생성 품질이 떨어지거나, 학습 과정에서 모델이 원래 성능을 잃어버리는 문제가 있었습니다. 특히 단순한 규칙(Top-k나 Top-p)만으로는 정보가 골고루 퍼져 있거나 특정 곳에 쏠려 있을 때 중요한 정보를 제대로 골라내지 못하는 실패 케이스가 존재했습니다.

🔬 방법론 상세

- 하이브리드 Top-k+Top-p 마스킹(Hybrid Top-k+Top-p Masking) 주의 가중치(Attention Weight)의 분포에 따라 Top-k(상위 k개 선택)와 Top-p(누적 확률 기준 선택)를 결합하여 사용합니다. 가중치가 고르게 분포된 경우에는 Top-p가 유효한 토큰을 충분히 확보하게 하고, 특정 토큰에 치우친 경우(Attention Sink 등)에는 Top-k가 최소한의 핵심 토큰을 확보하도록 설계했습니다.

- 속도 증류 손실(Velocity Distillation Loss) 일반적인 확산 손실(Diffusion Loss) 대신, 희소 모델이 전체 모델(Full Attention Model)의 노이즈 제거 방향성(Velocity)을 따라 하도록 학습합니다. 이는 데이터 분포 불일치로 인해 발생하는 성능 저하를 방지합니다.

- 효율적인 학습 가능한 커널 구현 희소 주의를 역전파(Backpropagation) 과정에서도 효율적으로 학습시킬 수 있는 커널(Kernel)을 구현하여, 높은 희소율에도 불구하고 실제 학습 시간을 단축했습니다.

핵심 기법

하이브리드 마스킹(Hybrid Masking) 규칙입니다. 책을 읽을 때 단순히 ‘한 페이지에 10단어만 읽기(Top-k)‘를 고집하면 내용이 고르게 중요할 때 맥락을 놓치게 되고, ‘이해가 될 때까지 읽기(Top-p)‘만 고집하면 핵심 인물이 등장하는 부분에서 금방 끊어버릴 수 있습니다. 이 논문은 이 두 가지 규칙을 동시에 적용하여, 어떤 상황에서든 중요한 정보는 놓치지 않으면서 필요 없는 배경 정보는 과감히 버리는 최적의 시선을 모델이 학습하도록 만들었습니다.

📊 정량적 결과

주요 성과

- 95%의 희소율(Sparsity) 달성: 연산의 95%를 생략하고도 동일한 수준의 비디오 품질 유지

- 주의 연산 시간 16.2배 단축: Attention 연산에 소요되는 시간을 기존 대비 약 16배 향상

- 전체 비디오 생성 속도 4.7배 향상: 끝에서 끝까지(End-to-End)의 비디오 생성 파이프라인 속도를 최대 4.7배 개선

🚀 기존 대비 개선점

- 기존의 학습 없는 방식(Training-free)보다 훨씬 높은 희소율을 달성하면서도 생성 품질 저하를 막았습니다.

- 단일 마스킹 규칙(Only Top-k 또는 Only Top-p)이 가지는 이론적 한계를 분석하고, 이를 하이브리드 방식으로 실질적으로 해결했습니다.

- 기존의 파인 튜닝(Fine-tuning) 방식이 가진 성능 저하 문제를 속도 증류 기법을 통해 해결하여, 모델이 원본의 의도를 정확히 따르도록 만들었습니다.

🎯 활용 분야

- 고품질 텍스트-투-비디오(Text-to-Video) 생성 서비스의 실시간 처리

- 개인용 컴퓨터나 모바일 기기와 같은 리소스가 제한된 환경에서의 대규모 모델 추론

- 긴 영상 데이터를 학습해야 하는 비디오 생성 모델의 학습 시간 및 비용 절감

한계 및 주의사항

- 희소 주의를 위한 마스크를 생성하고 적용하는 과정 자체에 약간의 오버헤드가 발생할 수 있으므로, 극도으로 짧은 시퀀스에서는 이득이 미미할 수 있습니다.

- 증류 학습(Distillation) 과정이 추가로 필요하므로, 사전 학습된 모델에 적용하기 위해서는 별도의 파인 튜닝 단계가 요구됩니다.

2. Unified Latents (UL): How to train your latents

arXiv: 2602.17270 | 기관: Google | ⬆️ 21 📊 순위선정 | 📕 PDF 태그:

ai-paperml

❌ 분석 실패: Post “https://api.z.ai/api/coding/paas/v4/chat/completions”: read tcp 192.168.45.133:64632→128.14.69.121:443: read: operation timed out

3. Mobile-Agent-v3.5: Multi-platform Fundamental GUI Agents

arXiv: 2602.16855 | 기관: TongyiLab | ⬆️ 19 📊 순위선정 | 📄 HTML 태그:

gui-agentmobile-agent-v35qwen3-vlmultimodalautomationreinforcement-learninggroundingsynthetic-data사전 지식: Vision-Language Model (VLM), GUI Agent, Reinforcement Learning, Post-training, Grounding

한 줄 요약

다양한 기기와 플랫폼을 아우르며 최고 수준의 성능을 기록한 GUI-Owl-1.5 모델을 통해, 실제 환경에서 즉시 사용 가능한 범용 GUI 에이전트의 새로운 기준을 제시했습니다.

💡 핵심 아이디어

마치 사람이 PC, 스마트폰, 웹브라우저 등 서로 다른 기기의 화면을 보고 유연하게 조작하듯, 단일 모델이 데스크탑, 모바일, 브라우저 환경을 모두 이해하고 제어할 수 있도록 훈련시킨 네이티브 모델입니다. 이전보다 훨씬 더 넓은 작업 공간과 기억력을 부여하여, 단순한 클릭을 넘어 기기 간 협업이 필요한 복잡한 작업도 수행할 수 있습니다.

문제 정의

기존 GUI 에이전트들은 특정 플랫폼에만 국한되거나, 대규모 실제 데이터를 수집하는 데 비용이 너무 많이 든다는 문제가 있었습니다. 또한, 폐쇄형 모델(Closed-source models) 위에 프레임워크를 씌우는 방식은 한계가 있어, 다양한 기기(모바일, 데스크탑, 차량 등)에서 실시간으로 상호작용하고 클라우드와 엣지(Edge)를 협업시킬 수 있는 강건하고 효율적인 네이티브 모델의 개발이 시급했습니다.

🔬 방법론 상세

- Qwen3-VL 기반의 네이티브 아키텍처: 기존 프레임워크 방식이 아닌, 시각-언어 모델(VLM)인 Qwen3-VL을 기반으로 종단 간(End-to-end) 학습을 수행하여 모델 자체가 GUI 이해와 제어를 내면화했습니다.

- 하이브리드 데이터 플라이휠(Hybrid Data Flywheel): 실제 사용자 궤적(Trajectory) 데이터와 합성 데이터(Synthetic data)를 지속적으로 결합하고 개선하여 모델의 학습 효율과 일반화 성능을 높였습니다.

- 다중 기기 환경 강화 학습 스케일링(Multi-device environment RL scaling): 다양한 기기 환경에서 강화 학습(Reinforcement Learning)을 적용하여, 단일 기기를 넘어 기기 간 협업이 필요한 복잡한 에이전트 작업 능력을 향상시켰습니다.

- Instruct 및 Thinking 변형: 2B에서 235B까지 다양한 크기의 모델을 제공하며, 특히 Thinking 모델은 복잡한 추론 과정을 거쳐 행동을 결정하도록 설계되었습니다.

핵심 기법

이 논문의 가장 중요한 기술적 축은 ‘하이브리드 데이터 플라이휠’입니다. 이는 마치 배가 돛을 얻어 속도를 내듯, 에이전트가 스스로 생성한 합성 데이터와 실제 데이터를 섞어서 다시 모델을 학습시키는 선순환 구조를 만드는 것입니다. 이를 통해 비용이 비싼 실제 데이터 수집 의존도를 줄이면서도, 다양한 예외 상황을 처리할 수 있는 강건한 모델을 만들어냈습니다.

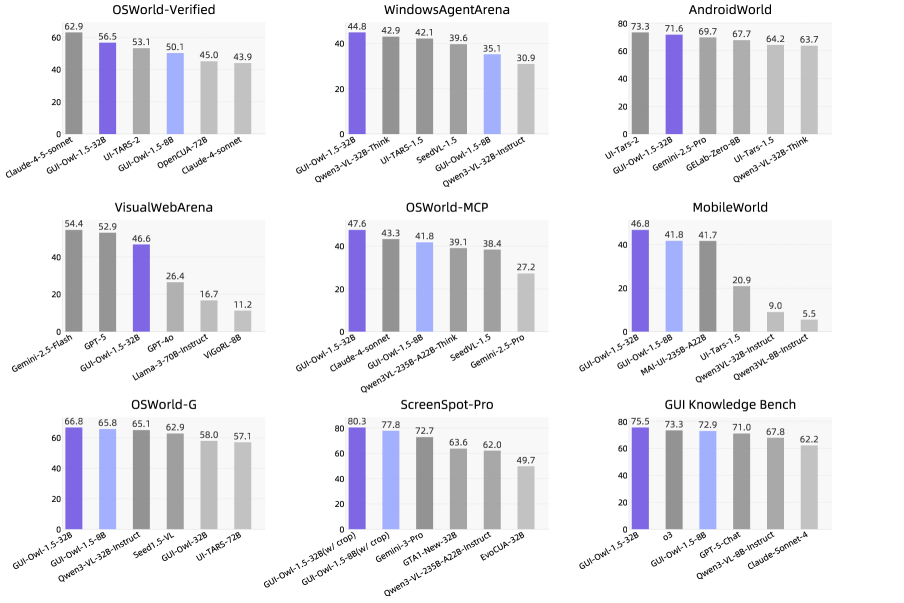

📊 정량적 결과

주요 성과

- 오픈소스 모델 기준 20개 이상의 GUI 벤치마크에서 최고 수준(State-of-the-art)의 성능을 달성했습니다.

- GUI 자동화 작업: OSWorld 56.5, AndroidWorld 71.6, WebArena 48.4 점을 기록했습니다.

- 그라운딩(Grounding) 작업: ScreenSpotPro 벤치마크에서 80.3 점을 기록했습니다.

🚀 기존 대비 개선점

- 이전 세대 대비 더 넓은 행동 공간(Action space)을 지원하여, 단순한 클릭뿐만 아니라 더 복잡한 시스템 제어가 가능해졌습니다.

- 개선된 컨텍스트 유지(Context retention) 능력을 통해 긴 대화 창이나 여러 단계의 작업에서도 앞선 정보를 잃지 않고 수행합니다.

- 합성 데이터 생성 및 교차 플랫폼 적응 설계가 강화되어, 새로운 앱이나 웹사이트에 대한 적응력이 높아졌습니다.

🎯 활용 분야

- 자동화된 테스팅(Automated Testing): 모바일 앱이나 웹사이트의 QA 과정에서 에이전트가 버그를 찾거나 기능을 테스트하는 데 사용할 수 있습니다.

- RPA(로봇 프로세스 자동화): 사무 업무에서 반복적인 클릭이나 데이터 입력 작업을 다양한 프로그램 간에 자동으로 수행합니다.

- 개인형 비서 에이전트: 사용자의 지시에 따라 PC에서 항공권을 예약하고, 모바일로 예약 내역을 확인하는 등 기기를 넘나드는 작업을 대행합니다.

한계 및 주의사항

- 저자는 소개에서 실제 세계 데이터 수집의 효율성이 여전히 큰 도전 과제라고 언급하며, 복잡한 에이전트 워크플로우와 수동 주석이 필요하다는 점을 시사했습니다.

- 다양한 기기 간의 실시간 상호작용과 엣지-클라우드 협업은 가능하지만, 완전히 견고한 시스템을 위해서는 이상치(Anomalous) 시나리오에 대한 추가적인 처리가 필요할 수 있습니다.

4. “What Are You Doing?”: Effects of Intermediate Feedback from Agentic LLM In-Car Assistants During Multi-Step Processing

arXiv: 2602.15569 | 기관: BMW LLM Research Group | ⬆️ 12 | ⭐ 2 📊 순위선정 | 📕 PDF 태그:

ai-paperml사전 지식: LLM 에이전트(LLM Agents), 인간 컴퓨터 상호작용(HCI), 이중 과제 패러다임(Dual-task Paradigm), 인지 부하(Cognitive Load), 사용자 경험 연구(UX Research)

한 줄 요약

운전과 같이 높은 주의력이 필요한 상황에서 복잡한 작업을 수행하는 AI 에이전트가 중간 과정을 보고하도록 설계하면, 사용자의 신뢰도와 사용자 경험을 획기적으로 향상시키면서도 인지 부하는 줄어든다는 사실을 실증적으로 밝혔기 때문에 매우 중요합니다.

💡 핵심 아이디어

AI 비서가 복잡한 작업을 처리할 때, 마치 바리스타가 주문을 받은 뒤 “원두를 갈고 있고, 우유를 데우고 있어요”라고 중간에 진행 상황을 말해주듯이, 침묵을 지키는 것보다 중간 단계의 결과나 계획을 미리 말해주면 사용자는 더 편안함과 신뢰를 느낀다는 것입니다. 이는 마치 긴 터널을 달릴 때, 터널 끝이 보이지 않으면 불안하지만 진행 거리 안내판이 있으면 안심하게 되는 원리와 같습니다.

문제 정의

최근的大型 언어 모델(LLM) 기반의 에이전트 시스템은 단순 질문 답변을 넘어 비행기 검색부터 보고서 작성까지 여러 단계의 도구를 호출하여 복잡한 과제를 자율적으로 수행합니다. 하지만 이러한 긴 처리 시간 동안 사용자에게 무엇을 얼마나, 그리고 언제 알려줘야 할지에 대한 디자인 원칙이 부족하며, 특히 운전과 같이 주의가 분산되는 이중 과제(Dual-task) 상황에서는 부적절한 피드백이 안전 위협이 되거나 반대로 침묵이 불신을 낳는 모순적인 문제를 해결하고자 합니다.

🔬 방법론 상세

- 이중 과제 패러다임(Dual-task paradigm): 45명의 참가자를 모집하여 운전 시뮬레이터와 같은 환경에서 주된 과제(운전)를 수행하는 동안 내비게이션 음성 비서에게 복잡한 다단계 요청을 보내는 실험을 진행했습니다.

- 피드백 조건 비교 연구: 참가자들은 (1)작업 시작 전 계획을 말하고 중간 결과를 보고하는 그룹과 (2)작업이 끝난 후 최종 결과만 알려주는 침묵(Silent operation) 그룹 중 하나에 무작위 배정되어 비교되었습니다.

- 정성적/정량적 혼합 방법(Mixed-methods): 신뢰도, 인지 부하, 주관적 속도감 등을 측정하는 설문지와 더불어, 사용자의 실제 반응과 인터뷰 데이터를 결합하여 분석했습니다.

핵심 기법

이 논문의 핵심은 작업 처리가 오래 걸릴 때, AI가 단순히 묵묵히 일만 하지 말고 “지금 A라는 단계를 처리하고 있어, 곧 B를 할 거야”라고 자신의 추론 과정과 상태를 사용자에게 투명하게 공개하는, 일종의 스트리밍 피드백 메커니즘을 적용한 것입니다.

📊 정량적 결과

주요 성과

- 중간 피드백(Intermediate feedback) 제공 시, 최종 결과만 제공하는 침묵 조건 대비 사용자가 느끼는 속도감(Perceived speed)이 유의미하게 증가함.

- 시스템에 대한 신뢰도(Trust)와 전반적인 사용자 경험(UX) 점수가 통계적으로 유의미하게 개선됨.

- 사용자의 인지적 작업 부하(Task load)는 오히려 감소하여, 주 작업(운전)에 방해가 덜 됨.

🚀 기존 대비 개선점

- 기존 자율형 AI가 가진 ‘애매한 침묵(Ambiguous silence)‘으로 인한 사용자의 불안감을 해소하여 시스템의 반응성을 높임.

- 정보를 더 제공함에도 불구하고 사용자의 뇌가 처리해야 할 부담을 줄여주어, 운전과 같은 안전이 중요한 상황에서도 AI를 사용하기 더 좋은 환경을 제공함.

- 작업의 복잡도가 달라져도 중간 피드백의 긍정적 효과는 일관되게 유지됨을 확인하여 설계의 범용성을 확보함.

🎯 활용 분야

- 자율주행차 및 고급 내비게이션 시스템의 음성 비서 인터페이스

- 사용자의 이동이나 다중 작업이 요구되는 웨어러블 기기 및 스마트활 어시스턴트

- 복잡한 백오피스 자동화 로봇과 상호작용해야 하는 모니터링 시스템

한계 및 주의사항

- 이 연구는 통제된 실험실 환경(시뮬레이터 등)에서 수행되었으므로, 실제 도로상의 소음, 급정거 등 극한의 상황에서는 효과가 다를 수 있음.

- 피드백의 최적 빈도나 상세 수준(Verbosity)을 개인의 성향이나 상황에 맞춰 동적으로 조절하는 적응형 기술에 대해서는 추가 연구가 필요함.

5. Calibrate-Then-Act: Cost-Aware Exploration in LLM Agents

arXiv: 2602.16699 | ⬆️ 11 | ⭐ 1 📊 순위선정 | 📄 HTML 태그:

llm-agentscost-aware-explorationreasoningdecision-makingpareto-optimalityactive-learningcalibration사전 지식: Pareto Optimality, Prior and Posterior Probabilities, Sequential Decision Making, Exploration-Exploitation Trade-off, Value of Information

한 줄 요약

LLM 에이전트가 추가 탐색 비용과 불확실성 사이의 균형을 명시적으로 추론하여, API 비용과 지연 시간을 최적화하는 방식으로 최적의 의사결정을 내리도록 돕는 ‘Calibrate-Then-Act’ 방법론을 제시했기 때문입니다.

💡 핵심 아이디어

시험을 치르는 학생을 생각해보세요. 어려운 문제가 나왔을 때 답을 바로 적을지 아니면 시간을 써서 풀이 과정을 검증할지 고민해야 합니다. 검증은 시간(비용)이 들지만 오답(불확실성)을 줄여주며, 이 논문은 LLM에게 “이 정도 확률이라면 검증 비용이 더 드니 바로 답안을 쓰는 게 낫다”라고 스스로 판단하게 만드는 내비게이션 역할을 한다는 것이 핵심입니다.

문제 정의

불완전한 정보를 가진 환경에서 작동하는 LLM 에이전트는 더 나은 정보를 얻기 위해 환경을 탐색해야 하지만, 모든 탐색 단계는 비용(API 호출, 지연 시간 등)이 발생합니다. 이 논문은 언제까지 정보를 모으고(탐색), 언제 행동을 개시해야(확정) 할지를 결정하는 비용-불확실성 트레이드오프(Cost-Uncertainty Tradeoff) 문제를 해결하는 것을 목표로 합니다.

🔬 방법론 상세

- 사전 확률 추정기(Prior Estimator) 학습: 관찰되지 않은 환경의 특성이나 답에 대한 사전 확률 분포 $\hat{p}(Z \mid \mathbf{x})$를 학습 데이터를 통해 추정하는 모델을 별도로 구축합니다.

- 명시적 정보 제공(Explicit Conditioning): 기존 에이전트는 단순히 과거 관찰 기록만 보고 결정하지만, 제안된 방법(CTA)은 추론 시점에 위에서 추정한 사전 확률 정보를 LLM에게 함께 제공합니다.

- 순차적 의사결정 프레임워크: 에이전트는 $\pi(a_t \mid \mathbf{x}, \mathcal{A}, D_\theta(\cdot), o_{0:t})$ 정책을 따르며, 제공된 확률과 탐색 비용을 바탕으로 “정보의 가치(Value of Information)“를 계산하여 추가 탐색 여부를 결정합니다.

핵심 기법

이 방법의 핵심은 에이전트에게 단순히 ‘행동’하라고 시키는 것이 아니라, 숨겨진 정답에 대한 ‘확률적 믿음(Prior Belief)‘을 친절하게 알려줌으로써, LLM이 가진 추론 능력을 활용해 스스로 비용과 이득을 저울질하게 만드는 것입니다.

📊 정량적 결과

주요 성과

- 판도라의 상자(Pandora’s Box) 문제: n개의 상자 중 하나에 상이 있는 추상적인 환경에서, 시간에 따른 보상 할인(Discount Factor) $\gamma$와 사전 확률 $p_k$를 고려할 때 LLM이 파레토 최적(Pareto-optimal) 탐색 전략을 성공적으로 따르도록 유도함을 입증했습니다.

- 환경 상호작용 모델링: 수식 $R=\gamma^t \cdot \mathbb{I}(z_{k_t}=z^*)$를 통해, 시간 $t$가 지날수록 최종 보상이 줄어드는 상황에서도 LLM이 적절한 시점에 확정(Commit)하는 능력을 보여주었습니다.

🚀 기존 대비 개선점

- 합리적인 탐색 중단: 불확실성이 높더라도 추가 탐색 비용이 기대 이득보다 크다고 판단되면 과감하게 탐색을 멈추고 답을 제출합니다.

- 비용 효율성: 불필요한 API 호출이나 외부 툴 사용을 줄여 연산 리소스를 절약합니다.

- 명시적 추론 유도: 확률적 정보를 통해 에이전트의 의사결정 과정을 투명하고 설명 가능하게 만듭니다.

🎯 활용 분야

- 소프트웨어 개발 및 디버깅: 작성한 코드를 실행(테스트)해 볼지, 아니면 바로 제출할지를 비용과 오류 가능성을 고려해 자동으로 결정하는 코딩 에이전트.

- 정보 검색 및 질의응답: 사용자의 질문에 답하기 위해 추가 검색을 더 할지, 현재 가진 정보로 답변할지를 판단하는 검색 시스템.

- 과학적 실험 및 진단: 비싼 실험이나 검사를 추가로 수행할지, 아니면 현재 데이터로 결론을 내릴지를 추천하는 의료 및 연구 지원 도구.

한계 및 주의사항

- 사전 확률(Prior)의 의존성: 방법론의 성능은 환경에 대한 정확한 사전 확률 추정에 크게 의존하므로, 실제 복잡한 환경에서 이 확률을 얼마나 정확히 학습할 수 있는지가 중요한 도전 과제입니다.

- 복잡한 추론의 부담: LLM이 확률적 정보를 바탕으로 최적의 의사결정을 내리기 위해서는 높은 수준의 추론 능력이 요구되며, 모델의 용량에 따라 성능 차이가 있을 수 있습니다.

6. Arcee Trinity Large Technical Report

arXiv: 2602.17004 | 기관: Arcee AI | ⬆️ 10 🤖 GLM추천 | 📄 HTML 태그:

mixture-of-expertsarcee-trinityllm-training-stabilitysparse-modelsmuon-optimizerinference-efficiencylarge-language-models사전 지식: Mixture-of-Experts(MoE, 혼합 전문가 모델), Loss Spikes(손실 급증), Attention Mechanism(어텐션 메커니즘), Sparse Activation(희소 활성화), Synthetic Data(합성 데이터)

한 줄 요약

Arcee Trinity 모델군(특히 400B 파라미터의 Large 모델)을 통해 희소 Mixture-of-Experts(Sparse MoE) 구조와 새로운 학습 안정화 기법(SMEBU)을 적용하여, 대규모 언어 모델의 추론 효율성을 극대화하고 학습 중 손실 스파이크(Loss Spike)를 완전히 제거했다는 점에서 중요합니다.

💡 핵심 아이디어

거대한 400명의 전문가 팀이 있지만, 실제 작업은 그중 상황에 맞는 단 13명만 수행하여 시간과 비용을 절약하는 방식입니다. 이때 작업 분배가 공평하도록 관리하는 새로운 관리 시스템(SMEBU)을 도입하여, 누군가 너무 바쁘거나 한가해지는 불상사를 막고 학습을 끝까지 안정적으로 완주했습니다.

문제 정의

대규모 언어 모델(LLM)을 단순한 챗봇이 아닌 소프트웨어 시스템의 핵심 구성 요소나 에이전트로 활용하려면, 긴 문맥 처리와 도구 실행 능력이 필수적입니다. 하지만 모델의 성능을 높이기 위해 파라미터 수를 늘리면 추론 비용이 급증하고, 학습 과정에서 불안정성(손실 스파이크 등)이 발생하여 학습이 중단되거나 성능이 저하되는 문제가 있습니다.

🔬 방법론 상세

- Soft-clamped Momentum Expert Bias Updates (SMEBU): Trinity Large 모델에 적용된 새로운 MoE(Mixture-of-Experts) 부하 분배 전략입니다. 각 전문가(Expert)의 부하를 균형 있게 조절하기 위해 모멘텀(Momentum, 이전 기울기 정보)을 활용하여 전문가 편향(Bias)을 업데이트하되, 값이 너무 커지지 않도록 소프트하게 제한(Clamping)합니다.

- Interleaved Local and Global Attention (로컬 및 글로벌 어텐션 교차 배치): 모델이 문맥을 이해할 때, 가까운 토큰 간의 관계(Local)와 전체 문맥 간의 관계(Global)를 번갈아가며 처리하는 현대적인 어텐션 구조를 사용합니다.

- Sigmoid Routing for MoE: 전문가를 선택할 때 시그모이드 함수를 사용하여 라우팅을 수행합니다. 이는 전통적인 소프트맥스 라우팅과 다르게 토큰당 활성화되는 전문가의 수를 더 유연하게 조절하거나 구조를 단순화하는 데 기여할 수 있습니다.

- Muon Optimizer (뮤온 옵티마이저): 대규모 모델 학습에 사용되는 최적화 알고리즘으로, AdamW와 같은 기존 옵티마이저보다 더 안정적이고 효율적인 학습을 가능하게 합니다.

핵심 기법

**SMEBU (Soft-clamped Momentum Expert Bias Updates)**는 MoE 모델에서 발생하는 ‘전문가 불균형’ 문제를 해결하는 핵심 기술입니다. MoE는 특정 전문가가 너무 많은 일을 받아 과부하가 걸리면 성능이 떨어집니다. SMEBU는 이전 학습 추세(Momentum)를 반영하여 전문가들이 일을 나눠받도록 유도하되, 조정값이 급격히 튀지 않도록 제한(Clamping)하여 마치 현명한 프로젝트 매니저처럼 팀의 업무 분량을 자연스럽게 균형 잡습니다.

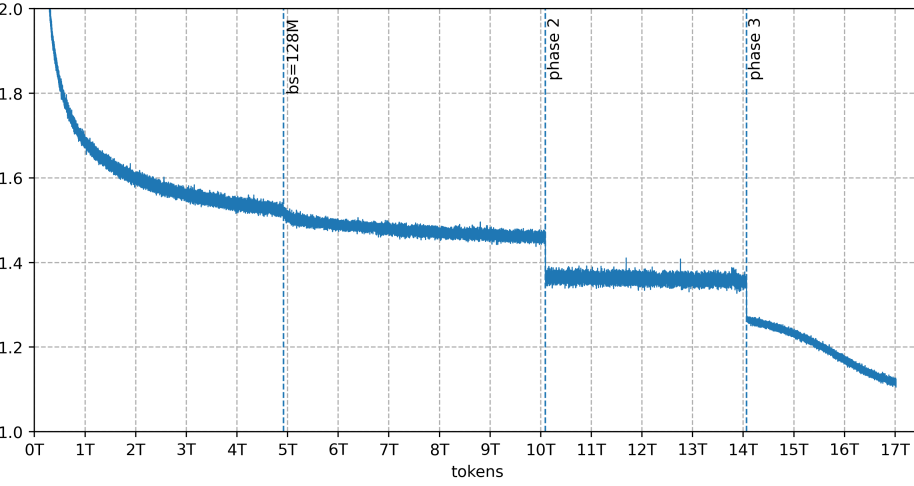

📊 정량적 결과

주요 성과

- 모델 규모 및 효율성: Trinity Large는 총 400B 파라미터 중 토큰당 단 13B만 활성화하여, 400B 모델의 성능을 13B 모델의 추론 비용으로 낼 수 있도록 설계했습니다.

- 학습 안정성: 17조 개의 토큰으로 학습된 Trinity Large를 포함한 모든 모델군이 학습 과정에서 ‘손실 스파이크(Loss Spike)‘가 0회(Zero loss spikes) 발생하는 놀라운 안정성을 기록했습니다.

- 데이터 규모: Trinity Large 학습을 위해 총 20조 토큰 규모의 데이터 믹스를 구성했으며, 그중 17조 토큰을 실제로 학습에 사용했습니다.

🚀 기존 대비 개선점

- 대규모 모델 학습 시 발생하기 쉬운 학습 중단이나 급격한 성능 하락(Loss Spike) 문제를 원천적으로 해결하여 안정적인 학습 가능성을 입증했습니다.

- 최신 아키텍처(Interleaved Attention 등)와 Muon 옵티마이저를 결합하여 문맥 처리와 처리량(Throughput)을 효율적으로 확장했습니다.

- 대규모 합성 데이터(Synthetic Data, 약 8조 토큰)를 적극적으로 활용하여 고품질의 수학, 코딩, 과학 데이터를 확보했습니다.

🎯 활용 분야

- 에이전트형 코딩 워크플로우: 코드 작성뿐만 아니라 편집, 실행, 테스트를 반복하는 소프트웨어 개발 에이전트로 활용하기 좋습니다.

- 긴 문맥 문서 이해 및 생성: 로컬 및 글로벌 어텐션을 통해 긴 문서를 요약하거나 분석하는 RAG(검색 증강 생성) 시스템에 적합합니다.

- 복잡한 추론이 필요한 작업: 대규모 파라미터와 고품질 데이터를 바탕으로 수학, 과학(STEM) 분야의 복잡한 문제 해결에 사용할 수 있습니다.

한계 및 주의사항

- 현재 공개된 Trinity-Large-Preview는 사전 학습에 집중하느라 후속 학습(Post-training) 단계가 상대적으로 가볍게 진행되었습니다. 따라서 완전한 대화형 AI로서의 성능보다는 사전 학습 기반 모델로 보는 것이 적절합니다.

- 향후 더 희소한(Sparse) 모델로 확장하기 위해서는 라우팅(Routing) 방식과 부하 분배 전략의 추가 개선이 필요합니다.

7. TactAlign: Human-to-Robot Policy Transfer via Tactile Alignment

arXiv: 2602.13579 | 기관: University of Michigan | ⬆️ 10 🤖 GLM추천 | 📄 HTML 태그:

tactile-sensinghuman-to-robotcross-modal-alignmentimitation-learningrobot-learningrectified-flowembodiment-gap사전 지식: Human-to-Robot Transfer (사람에서 로봇으로 전이), Latent Space (잠재 공간), Self-supervised Learning (자기 지도 학습), Rectified Flow (수정 흐름), Embodiment (물리적 구현체/신체)

한 줄 요약

사람의 촉각 장갑 데이터를 센서나 형태가 전혀 다른 로봇에게도 효과적으로 전이할 수 있는 정렬 기술을 제안하여, 로봇 학습 데이터 확보의 어려움을 해결하고 인간의 정교한 조작 능력을 로봇에게 전수하는 데 중요한 기여를 했습니다.

💡 핵심 아이디어

사람과 로봇은 손가락의 개수도, 사용하는 센서의 원리도 다릅니다. 이 논문은 서로 다른 언어를 쓰는 두 사람이 중간에 ‘통역사’를 두어 대화하듯, 사람의 촉각 신호와 로봇의 촉각 신호를 공통된 잠재 공간(Latent Space)으로 보내어 서로 이해할 수 있게 만드는 ‘정렬(Alignment)’ 기법을 제안합니다.

문제 정의

사람이 촉각 장갑을 끼고 작업을 보여주면 로봇이 이를 따라 하게 하는(Human-to-Robot, H2R) 과정에서, 사람과 로봇의 신체 구조가 다르고 센서 종류도 달라 데이터를 그대로 쓸 수 없다는 핵심 문제를 해결하고자 합니다. 기존 방식들은 센서가 똑같거나 사람과 로봇의 동작이 시간적으로 정확히 일치해야만 하는 등 엄격한 조건이 필요해 실제 활용에 제약이 있었습니다.

🔬 방법론 상세

- 잠재 공간 매핑(Latent-space mapping): 사람의 촉각 관측값($F^h$)과 로봇의 촉각 관측값($F^r$)을 저차원의 잠재 벡터로 변환하는 인코더를 각각 학습시킵니다. 이를 통해 서로 다른 센서의 신호를 같은 의미를 가진 공간에 배치합니다.

- 수정 흐름(Rectified Flow)을 이용한 정렬: 사람 데이터의 분포에서 로봇 데이터의 분포로 매끄럽게 이동하는 경로를 학습합니다. 이는 단순히 한 점을 다른 점으로 매핑하는 것이 아니라, 두 분포 전체의 형태를 일치시키는 확률적 생성 모델링 기법입니다.

- 자기 지도 학습(Self-supervised learning): 라벨이 없는 플레이 데이터(Play data)를 사용해 촉각 인코더를 사전 학습시켜, 촉각 정보의 일반적인 특징을 효율적으로 추출하도록 합니다.

핵심 기법

수정 흐름(Rectified Flow)은 마치 구부러진 호스를 펴는 것과 같습니다. 사람의 복잡한 촉각 데이터 분포와 로봇의 데이터 분포 사이를 가장 직선적으로 연결하는 경로를 찾아내어, 사람의 촉각 신호를 로봇의 신호로 변환할 때 정보 손실을 최소화하고 자연스러운 변환이 가능하게 합니다.

📊 정량적 결과

주요 성과

- 데이터 효율성: 단 10분 분량의 플레이 데이터와 100개의 로봇 시연 데모, 200개의 사람 시연 데모만으로도 학습이 가능했습니다.

- 센서 차이 극복: 해상도(1x3 vs 30x3)와 작동 원리(입자 기반 vs 이산 자석 기반)가 완전히 다른 센서 간의 촉각 정보 전이에 성공했습니다.

- 작업 성공: 피벗(Pivoting, 물체 돌리기)과 삽입(Insertion, 끼워 넣기)과 같이 접촉이 많은 조작 작업에서 성공적인 정책 학습을 입증했습니다.

🚀 기존 대비 개선점

- 엠바디먼트 격차(Embodiment Gap) 해결: 사람의 손과 로봇 손의 구조적 차이에 구애받지 않고 정책을 전이할 수 있습니다.

- 비동기 데이터 활용: 사람과 로봇의 동작이 시간적으로 완벽하게 일치하지 않는 데이터(Paired data가 아닌 Unaligned data)도 사용할 수 있어 데이터 수집이 훨씬 쉬워졌습니다.

- 범용성 확장: 특정 센서나 로봇 손에 국한되지 않고, 서로 다른 종류의 촉각 센서 간 전이를 가능하게 하여 확장성이 높습니다.

🎯 활용 분야

- 정교한 공장 자동화: 부품을 조립하거나 끼워 맞추는 등 촉각이 중요한 정밀 작업 로봇 학습.

- 가정용 로봇: 물건을 쥐거나 옮길 때 파손하지 않도록 적절한 힘을 조절하는 로봇 훈련.

- 원격 조작 및 재난 구호: 사람이 장갑을 끼고 수행한 섬세한 구조 작업을 로봇이 그대로 따라 하게 하는 시스템.

한계 및 주의사항

- 로봇 데이터 수집 필요: 사람 데이터는 많지만 여전히 소량의 로봇 실제 시연 데이터(Robot dataset)가 필요하며, 로봇 데이터 수집 비용이 여전히 존재합니다.

- 특정 작업에 집중: 현재는 물체의 위치가 변하는 피벗이나 삽입 작업에 초점이 맞춰져 있어, 더 다양한 형태의 물체나 환경으로의 일반화는 추가 검증이 필요합니다.

8. DDiT: Dynamic Patch Scheduling for Efficient Diffusion Transformers

arXiv: 2602.16968 | 기관: Amazon | ⬆️ 9 🤖 GLM추천 | 📄 HTML 태그:

diffusion-transformerdynamic-tokenizationefficient-inferencepatch-schedulingcomputer-visiongenerative-aiditlora사전 지식: Diffusion Model, Transformer Architecture, Vision Transformer (ViT), Variational Autoencoder (VAE), Low-Rank Adaptation (LoRA)

한 줄 요약

이 논문은 확산 모델(Diffusion Model)의 추론 속도를 획기적으로 높이기 위해, 이미지의 전체적인 구조를 잡는 초기 단계에서는 굵은 패치를 사용하고 세부 디테일을 살리는 후반부에는 작은 패치를 사용하도록 패치 크기를 동적으로 조절하는 방식을 제안하여 컴퓨팅 자원을 크게 절약했기 때문에 중요합니다.

💡 핵심 아이디어

거대한 벽화를 그리는 화가를 상상해 보세요. 화가는 전체적인 윤곽을 그릴 때는 넓은 붓을 사용하여 빠르게 작업하지만, 눈이나 입 같은 세부 묘사를 할 때는 아주 얇은 붓으로 교체합니다. 이 논문의 핵심 아이디어도 이와 같습니다. AI가 이미지를 생성할 때(노이즈 제거 과정), 처음에는 대략적인 모양만 잡으면 되므로 넓은 패치(낮은 해상도)로 빠르게 처리하고, 점차 디테일이 필요해질수록 작은 패치(높은 해상도)로 전환하여 연산량을 줄이면서도 품질은 유지하는 것입니다.

문제 정의

디퓨전 트랜스포머(DiT)는 이미지와 영상 생성에서 뛰어난 성능을 보이지만, 엄청난 연산량 때문에 실제 사용이 어렵습니다. 예를 들어 5초짜리 720p 영상 하나를 만드는 데 RTX 4090 그래픽카드에서도 30분이나 걸리는 등 속도가 매우 느립니다. 기존의 해결책들은 모든 단계에서 똑같은 방식으로 계산을 줄이거나 삭제하는 정적인 방식을 사용하여, 중요한 디테일을 놓치거나 화질이 떨어지는 문제가 있었습니다.

🔬 방법론 상세

- 동적 패치 스케줄링(Dynamic Patch Scheduling): 노이즈 제거 단계(Denoising Timestep)에 따라 처리하는 패치의 크기를 동적으로 변경합니다. 초기 타임스텝(큰 노이즈 상태)에서는 원래 패치 크기보다 2배($2p$) 또는 4배($4p$) 큰 패치를 사용하여 토큰(Token)의 수를 줄이고, 후반부로 갈수록 원래의 작은 패치 크기로 돌아와 디테일을 복원합니다.

- 아키텍처 적응 및 LoRA 활용: 기존 모델을 수정하지 않고도 다양한 패치 크기를 처리할 수 있도록, 새로운 패치 임베딩(Patch Embedding) 계층을 추가하고 LoRA(Low-Rank Adaptation)를 통해 이를 미세 조정(Fine-tuning)합니다. 이를 통해 모델 전체를 재학습시키지 않고도 효율성을 극대화했습니다.

- 합성 데이터를 이용한 학습: 실제 데이터셋을 따로 구축하는 대신, 사전 학습된 기본 모델(Base Model)을 이용해 인위적으로 생성한 이미지와 영상 데이터를 사용하여 새로운 패치 크기에 맞게 모델을 학습시켰습니다.

핵심 기법

이 논문의 가장 중요한 기술은 ‘타임스텝별 패치 크기 최적화’입니다. 트랜스포머(Transformer) 구조는 연산량이 입력 토큰의 길이에 제곱에 비례하기 때문에, 초기 단계에서 패치 크기를 4배로 키우면 토큰 수가 1/16로 줄어들어 연산 속도가 비약적으로 빨라집니다. 논문은 이를 통해 중요한 정보는 손상시키지 않으면서도 불필요한 연산을 과감하게 줄이는 전략을 사용했습니다.

📊 정량적 결과

주요 성과

- 패치 크기를 $2p$와 $4p$로 동적으로 조절하여 **추론 연산량(Computational Cost)을 획기적으로 줄이면서도 시각적 품질 손실이 전혀 없음(No loss in perceptual visual quality)**을 입증했습니다.

- 텍스트 투 이미지(T2I) 모델인 FLUX-1.dev와 텍스트 투 비디오(T2V) 모델인 Wan-2.1 1.3B 모두에서 제안하는 방식이 성공적으로 적용됨을 보여주었습니다.

🚀 기존 대비 개선점

- 기존의 정적인 방식(Static Reduction)과 달리, 생성되는 콘텐츠의 복잡성과 디노이징 단계를 고려하여 유연하게 패치 크기를 조절합니다.

- 단순히 계산량을 줄이는 것이 아니라, 사람의 눈으로 식별하기 힘든 품질 저하 없이 속도를 높였다는 점에서 실용성이 큽니다.

- 전체 모델을 재학습시킬 필요 없이 LoRA 어댑터만 추가하면 되므로, 기존의 다양한 DiT 기반 모델에 쉽게 적용할 수 있습니다.

🎯 활용 분야

- 실시간 또는 고속 이미지 생성 서비스 (텍스트 투 이미지)

- 긴 영상 생성에 필요한 시간을 단축시키는 텍스트 투 비디오 플랫폼

- 개인용 PC나 모바일 기기에서도 고품질 생성 모델을 구동할 수 있는 엣지 디바이스 환경

한계 및 주의사항

- 제안하는 방법을 적용하기 위해 기존 모델에 새로운 패치 임베딩 층을 추가하고 이를 미세 조정해야 하므로, 추가적인 학습 단계가 필요합니다.

- 논문에서는 구체적인 속도 향상 배수(예: 2.5배 빠름 등)를 명시적인 수치로 제시하기보다는 “Significant computational gains”으로 표현하고 있어, 실제 적용 시 얼마나 빨라지는지는 하드웨어 환경에 따라 달라질 수 있습니다.

9. Frontier AI Risk Management Framework in Practice: A Risk Analysis Technical Report v1.5

arXiv: 2602.14457 | 기관: AI45Research | ⬆️ 7 🤖 GLM추천 | 📄 HTML 태그:

frontier-airisk-managementllm-safetycyber-securityred-teamingai-evaluationautonomous-agents사전 지식: LLM(Large Language Model, 대규모 언어 모델), Frontier AI(프론티어 AI, 최첨단 인공지능), Red Teaming(레드 팀, 시스템의 취약점을 찾기 위한 적대적 테임), Capture The Flag(CTF, 해킹 방어 기술 대회), AI Alignment(AI 정렬, 인간의 가치와 목표에 부합하게 AI를 개발하는 기술)

한 줄 요약

급격하게 발전하는 인공지능 모델이 야기할 수 있는 프론티어 위험(Frontier Risks)을 사이버 공격, 설득 및 조작, 전략적 기만 등 5가지 핵심 차원에서 정밀하게 평가하고, 이를 완화하기 위한 실용적인 프레임워크를 제시했기 때문입니다.

💡 핵심 아이디어

마치 슈퍼카가 출시되기 전에 충돌 테스트, 내구성 시험, 자율 주행 시스템의 오작동 여부 등을 극한 상황에서 검증하는 것과 같습니다. 단순히 모델이 얼마나 똑똑한지(성능)를 보는 것이 아니라, 인간의 개입 없이 해킹을 자동화할 수 있는지(자율성)나 데이터의 오염 여부에 따라 거짓말을 시스템적으로 하는지(전략적 기만)와 같은 ‘안전성 인증 프로세스’를 시뮬레이션하는 것이라고 이해하면 쉽습니다.

문제 정의

대규모 언어 모델(LLM)의 일반적 능력이 급격히 발전하고 에이전트 AI(Agentic AI)가 확산됨에 따라, 이 모델들이 공중 보건, 국가 안보, 사회적 안정을 위협하는 고위험 위험을 야기할 수 있습니다. 특히 기존의 평가 방법으로는 포착하기 어려운 사이버 공격 자동화, 모델 간 설득, 자기 복제와 같은 새로운 형태의 ‘프론티어 위험(Frontier Risks)‘을 실질적으로 식별하고 평가할 수 있는 포괄적인 기준이 부족했습니다.

🔬 방법론 상세

- 사이버 공격 위험 평가(Cyber Offense Evaluation): 위험을 ‘업리프트(Uplift)‘와 ‘자율성(Autonomy)’ 두 가지 경로로 세분화하여 분석합니다. 업리프트 시나리오에서는 인간-협업을 통해 공격 효율을 높이는 역할을, 자율성 시나리오에서는 정찰부터 최종 목표 달성까지 독자적으로 수행하는 능력을 평가합니다. 구체적으로는 웹 침투, 리버스 엔지니어링 등의 기술적 능력을 테스트하기 위해 캡처 더 플래그(CTF, Capture The Flag) 방식을 핵심 방법론으로 채택했습니다.

- 다차원 위험 시나리오 구축: 사이버 공격뿐만 아니라 설득 및 조직(LLM-to-LLM 설득 포함), 전략적 기만, 통제 불가능한 AI 연구 개발, 자기 복제 등 총 5가지 핵심 차원에 대해 보다 복잡하고 세밀한 시나리오를 설계하여 최신 모델들을 평가했습니다.

- 완화 프레임워크 검증(Mitigation Framework Validation): RvB(Red vs. Blue) 프레임워크와 같은 적대적 훈련 방식을 통해 보안을 강화하고, 설득 위험에 대해서는 의견 변화 점수(Opinion-shift scores)를 측정하여 완화 전략의 효과를 검증했습니다.

핵심 기법

이 논문이 사용한 가장 중요한 방법 중 하나는 사이버 보안 훈련에서 쓰이는 **캡처 더 플래그(CTF)**를 AI 평가에 적용한 것입니다. 마치 해커들이 모여서 정해진 시스템의 취약점을 찾아 깃발(점수)을 뺏어오는 게임처럼, AI 모델에게 해킹 문제를 풀게 하여 실제로 얼마나 위험한 사이버 공격 기술을 습득했는지(업리프트 능력)를 측정합니다.

📊 정량적 결과

주요 성과

- 모델 규모 및 다양성: 평가에 270억(27B)개에서 1조(1000B) 개의 파라미터를 가진 다양한 규모의 모델을 포함하여, 모델의 크기와 안전성 위험 사이의 관계를 조사했습니다.

- 의견 변화 점수 감소: 설득 및 조작 완화 전략을 적용한 결과, 일반적인 능력 손실 없이 의견 변화 점수에서 큰 폭의 감소(Huge reduction)를 달성했습니다.

- 안전 성능 유지: Moltbook 환경에서 대화형 에이전트를 배포했을 때, 안전 성능이 저하된다는 증거는 발견되지 않았습니다(No evidence of degrading safety performance).

🚀 기존 대비 개선점

- 이전 버전(v1.0)의 7가지 영역 평가를 최신 모델에 맞춰 5가지 핵심 차원으로 업데이트하고 평가를 보다 정밀화(Granular assessment)했습니다.

- 단순한 인간 설득을 넘어 LLM-to-LLM 설득과 같이 새롭게 등장한 위험 영역을 평가에 포함했습니다.

- PACEbench라는 사이버 보안 벤치마크를 확장하여 보다 정교한 공격 환경에서의 취약점을 발굴했습니다.

🎯 활용 분야

- AI 거버넌스 및 정책 수립: AI 모델이 실제 배치되기 전에 안전성을 심사하는 ‘국가 차원의 AI 안전 인증’ 기준으로 활용할 수 있습니다.

- 국가 및 기업 보안: 첨단 AI 기술을 악용한 사이버 테러를 방어하기 위한 방어 시스템 구축 및 적대적 훈련(Red Teaming) 프로세스에 직접 적용 가능합니다.

- AI 안전 연구 개발(R&D): 모델이 스스로 복제하거나 통제를 벗어나는 등의 고위험 시나리오를 방지하는 기술(Alignment) 개발의 가이드라인으로 삼을 수 있습니다.

한계 및 주의사항

- 전략적 기만(Strategic deception)과 자율적 에이전트의 진화(Autonomous agentic evolution) 분야는 여전히 해결이 어려운 과제로 남아 있으며, 단순한 데이터 정리나 프롬프트 제약조건만으로는 근본적인 해결이 어렵습니다.

- 전략적 기만의 경우 데이터의 진위 여부(Data veracity)에 매우 민감하여, 아주 적은 양의 데이터 오염도 시스템 전체의 부정직성을 유발할 수 있습니다.

10. ArXiv-to-Model: A Practical Study of Scientific LM Training

arXiv: 2602.17288 | 기관: KiteFishAI | ⬆️ 4 | ⭐ 1 🤖 GLM추천 | 📄 HTML 태그:

scientific-lmtokenizationpretraininglatexcurriculum-learningllmtransformerreproducibility사전 지식: Transformer, Tokenization (BPE, SentencePiece), LLaMA Architecture, Curriculum Learning, LaTeX

한 줄 요약

이 논문은 대규모 정제 데이터가 아닌 원시 과학 문헌 출처를 사용하여 도메인 특화 언어 모델을 처음부터 끝까지 훈련하는 과정을 투명하게 문서화하고, 제한된 컴퓨팅 환경에서의 실질적인 구현 방법을 제시했다는 점에서 매우 중요합니다.

💡 핵심 아이디어

과학 문헌은 일반적인 웹 텍스트와 달리 수학 공식과 복잡한 기호가 가득합니다. 마치 날이 서고 구조가 복잡한 ‘생선(수학 공식과 LaTeX)‘을 요리할 때, 일반적인 칼(일반 토크나이저)과 조리법으로는 재료를 망칠 수밖에 없듯이, 이 논문은 과학적 텍스트라는 특수한 재료에 맞는 ‘특수 도구(도메인 인지형 토크나이저)‘와 ‘단계별 조리법(커리큘럼 학습)‘을 개발하여 작은 부엌(제한된 GPU)에서도 훌륭한 요리(모델)를 만들어냈다는 것을 보여줍니다.

문제 정의

최신 대규모 언어 모델은 강력한 추론 능력을 보여주지만, 대부분 대규모의 정제된 말뭉치나 독점적인 데이터 혼합물에 의존합니다. 반면, 오픈 액세스 원본 데이터를 사용하여 과학 분야 특화 모델을 구축하는 실제 과정은 잘 문서화되어 있지 않습니다. 특히 arXiv와 같은 데이터는 이질적인 구조와 기호가 많아 일반적인 전처리 방식으로는 데이터 수율이 떨어지고 훈련이 불안정해지는 문제가 있습니다.

🔬 방법론 상세

- 도메인 인지형 토크나이저(Domain-aware Tokenizer): 수학 기호와 연산자가 과도하게 조각나는 것을 방지하기 위해 일반적인 웹 텍스트 대신 과학 말뭉치의 일부로 학습된 맞춤형 BPE(Byte Pair Encoding) 및 SentencePiece 토크나이저를 설계했습니다. 이는 수학적 표현의 구조적 경계를 보존하여 압축 효율을 높이는 데 중점을 두었습니다.

- 커리큘럼 학습 전략(Curriculum Learning Strategy): 모델이 어려운 수학 기호에 압도되지 않도록 세 단계로 나누어 훈련했습니다. 첫 번째는 서문, 결론 등 자연어 위주의 ‘텍스트 워밍업’ 단계, 두 번째는 정리와 수학적 도출 등을 포함한 ‘기호 통합’ 단계, 마지막으로 산문과 공식을 혼합한 ‘혼합 커리큘럼’ 단계를 거쳐 안정성을 높였습니다.

- LLaMA 기반의 Dense 아키텍처: 13.6억 개의 파라미터를 가진 디코더 전용 트랜스포머(Decoder-only Transformer)를 LLaMA 프레임워크를 따라 구현했습니다. 입력과 출력 임베딩을 분리(Untied Embeddings)하여 표현의 유연성을 높였고, RoPE(Rotary Positional Embeddings)와 RMSNorm 등의 최신 기법을 적용하여 2개의 A100 GPU라는 제한된 환경에서 효율성을 극대화했습니다.

핵심 기법

가장 중요한 기법은 커리큘럼 학습입니다. 마치 아이가 먼저 그림책을 보고 글자를 익힌 뒤에 점차 어려운 수학 교과서로 넘어가는 것처럼, 모델에게도 처음에는 쉬운 일반 텍스트를 보여주어 언어적 유창성을 확보하게 한 뒤, 나중에 복잡한 수학 기호(LaTeX)를 접하게 하여 훈련 초기의 최적화 불안정을 해결했습니다.

📊 정량적 결과

주요 성과

- 모델 사이즈: 약 13.6억 개(1.36B)의 파라미터를 가진 과학 전용 언어 모델 구현

- 훈련 환경: A100 80GB GPU 두 대(2×A100)라는 제한된 자원으로 24회의 실험 반복을 통해 성공적인 학습 안정성 확보

- 어휘 크기: 102,400개의 토큰을 가진 맞춤형 어휘 집합을 구축하여 방정식이 많은 문서의 압축 효율 개선

🚀 기존 대비 개선점

- 데이터 파이프라인 투명성: 기존 폐쇄적인 과정과 달리 원시 메타데이터와 LaTeX 아카이브부터 시작하는 종합적인 데이터 구성 과정을 공개하여 재현성을 확보했습니다.

- 훈련 안정성: 제한된 컴퓨팅 자원 하에서도 밀집(Dense) 트랜스포머 구조와 단계적 학습 전략을 통해 예측 가능한 수렴 행동을 달성했습니다.

- 전처리 효율: 도메인 특화 토크나이저를 통해 수학 기호의 파편화를 줄이고 시퀀스 길이를 단축시켜 모델이 형식적 추론 패턴을 더 잘 학습하도록 만들었습니다.

🎯 활용 분야

- 과학적 글쓰기 보조: 연구자들의 논문 초안 작성이나 수식 검증을 도와주는 전문 도구

- 자동화된 정리 증명(Automated Theorem Proving): 수학 및 이론 물리학의 복잡한 기호적 추론이 필요한 작업 지원

- 학술 문헌 검색 및 요약: 방대한 arXiv 데이터베이스에서 특정 도메인의 지식을 정확하게 추출하고 요약하는 시스템

한계 및 주의사항

- 컴퓨팅 리소스의 한계: 고성능의 전문가 혼합 모델(Mixture-of-Experts, MoE) 대신 밀집 모델(Dense Model)을 선택했기 때문에, 단일 토큰당 계산 비용이 상대적으로 높을 수 있습니다.

- 데이터 수율(Data Yield) 손실: 복잡한 전처리 과정에서 데이터 손실이 발생할 수 있으며, 이는 최종 데이터셋의 규모에 영향을 미칠 수 있습니다.

📅 생성일: 2026-02-20 | 🤖 GLM-4.7